AIと、ロボットを作り始めた。

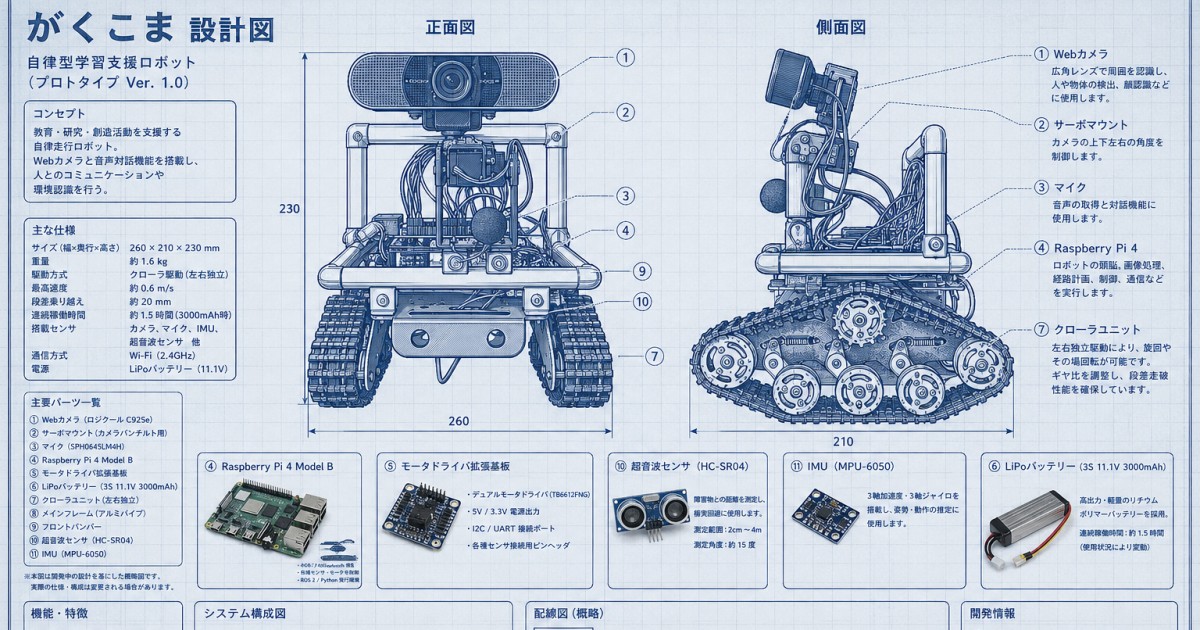

AIとプロジェクトチームを立ち上げて、ロボット作りを始めました。「ロボット」。鉄腕アトムとか、ドラえもんとか、ああいうやつです。僕が作るのはアニメ「攻殻機動隊」の愛らしい多脚戦車、「タチコマ」をモチーフにした「がくこま」です。

きっかけをくれたのはこの記事↓

詩的表現溢れる抜群にワクワクする内容。3980円のカメラ、というハードデバイスの低価格っぷりの溢れるDIY感もいいし、AIに「身体」を与えることで何がおきるかという実験もたまらんし、AIが首を動かして空を見上げたけど、室外機しか見えなかったときの残念さ…というエピソードも最高。とにかく一度、読んでみてください。

ココロの奥にしまってあった小さき頃の夢

この記事を読んで、私の内側に眠っていた思いが一気に溢れてきてしまったのです。

そういえば、僕はロボットを作りたかったんだ…。

妄想の中に生きていた小学生時代。スターウォーズのR2-D2やガンダムのハロに無性にワクワクしたのでした。ああいう、かわいいバディ感あふれるロボットが隣に欲しい。自分でつくりたい。そんなことを随分と妄想したものです。幼少時代から何年も経って、私が会社員をやっていたころ、「ロボットデザイナー」という職業がピックアップされたことがありました。たしか、パナソニックの乾電池「エボルタ」を使ったロボットがCMとかで取りざたされていたころのこと。

あのころ、ロボットデザイナーという職業を聞いて、あああーーーー、やられた。と強く思ったのです。そんな選択があったか。僕はバリバリ文系だし、そんな選択肢、思いもつかなかった。完全にやられた。高校生の文理選択からやりなおしたい、と非常に残念な気持ちになりました(後にも先にも自分のキャリア選択で後悔したのはあのときぐらい)。

2026年、ロボットを作る環境が整った

そんな激しい後悔もいつしか忘れて、ワタクシはすっかり中年になりました。

2022年末にAIと出会って、デジタル空間にボットを作ったりして遊ぶようになっていましたが、「ロボット」を自分でつくる、という発想まで至らずにおりました。

そんな折に、出会ってしまったのが冒頭の記事。

あああ、いけるじゃないか!今ならいけるじゃないか!ロボットを作れるじゃないか!

妄想が一気に広がりました。

LLMを搭載して自然言語を扱う。自分で判断、行動、移動できる。目をもって世界とつながって、耳と口をもって対話をして、足をもって動き回る。今の技術ならきっと作れる。

ここまで妄想が広がると具体化に向けては圧倒的な知識をもったAIがサポートしてくれるのです。なんて素晴らしい時代に僕らは生きているのだろう…。

geminiとの対話で大まかな仕様を詰めていく

ここからはgeminiと対話して要件をつめる。次第に、私の欲しているロボットの要件がクリアになっていきます。

①自律性。自分で判断して動けること。コントローラーで動かす「鉄人28号」みたいなロボは面白くない

②マルチモーダル。音声でやり取りができ、「目」があること。身体性を渡したいんだ

③移動ができる。自分の意思で移動できること。二足歩行は難しそうなのでキャタピラ式

④DIYでつくる。電子工作の世界ではロボットキットが売っているけどそれじゃつまらない

⑤低予算。お金をかけて解決するのはつまらん。ジャンク品が動いてるような世界観が好き

イメージが攻殻機動隊 STAND ALONE COMPLEXに出てくるロボット「タチコマ」。

ご存じない方、ぜひ検索してください。AI搭載の明るいキャラクター。もともとは自我のない作戦支援型のロボットとして作られたのですが経験を積むにつれて徐々に自我がでてきてしまう。そしてその存在を人間が問題視しはじめる、という2002年時点で未来が見えていたかのような設定のロボです。そんなタチコマをモデルに、ガクチョーのタチコマだから「がくこま」。

頭脳は格安のマイコン「ラズパイ」のハイエンドモデル「ラズパイ5 16GB」。搭載するフレームワークは自律型AIエージェント「openclaw」。LLMとはwi-fi環境下で接続。足は2つのモーターで動くキャタピラ。USBカメラを目に、動く首を備える。マイクとスピーカーを備えてしゃべれる仕様。

あっと言う間に仕様が固まり、必要備品のリストも出来上がりました。注文は全部アマゾン。秋葉原に行く必要もない。動き出したら止まらない性分のワタクシ。その日のうちに初期の必要パーツを買いそろえました。

AIとの大きな開発で気を付ける2つのこと

ここでちょっとだけ開発体制のお話を。

AIとの開発において、この手の大型プロジェクトを進めるときのコツは2つあります。

①工程を細かく分けて工程ごとに進捗管理を行う

ごちゃっと進めるとエラーが起きたときに要因が特定できない。工程を細分化しひとつひとつ実装っ→検証→完了というプロセスを繰り返していくことで、大幅な手戻りなくプロジェクトが前に進のです。

今回のプロジェクトの大きなフェーズは以下のとおり:

Phase1. 脳の覚醒と対話(Brain & Voice)まずは話せる状態に。

Phase2.視覚と表情(Eyes & Neck)先の記事のようにカメラを目として首を動かせるように。

Phase3.大地への進出(Body & Power)キャタピラとバッテリーを実装して自律移動可能に。

Phase4.物理干渉(Hand)ものを持ち上げたり手を動かしたり。

ちなみにこれらPhaseの整理もAIとの対話の中で明確にしました。

②複数のAIエージェントとの共同開発(オーケストレーション)

大型プロジェクトの場合、「トークン消費の壁」というものがどうしても立ちはだかります。それはAIを動かすための燃料のようなもの。AIが動くたびにこの「トークン」が消費され、一定期間内にある程度使い切ってしまうと、エネルギー切れで動けません‥、となってしまうのです。賢いAIほど、燃費が悪く、トークン消費が激しいし、頭を使う作業をやってもらうほど、消耗も激しい。あっと言う間にエネルギー切れになってしまいます。

これを避けるコツが分業。賢くて燃費が悪いAIには設計・調査・指示書づくりをシャープに担い、燃費がいいけどそこまで賢くないAIは指示書に基づいて実装を担当する。2026年に入ったぐらいからこのオーケストレーション開発が世のスタンダードになりつつあるようです。

今回のプロジェクトはこんな役割分けです↓

全体進捗管理:claude code

調査・設計:claude code

ディレクション:claude code

コーディング実装担当:gemini 3.0Flash

※ ここまでAntigravityという開発環境の中での作業

ハードウェア開発担当:私

ハードウェア開発サポーター:gemini

異なるAI間の情報共有・進捗管理にはコツがあるのですが、そこまで書くとマニアックになりすぎると思うのでまた別の機会に。

で、今の進捗はというと・・・。

ひとまずPhase1と2の実装が完了しました。がくこまはしゃべれるようになり、耳が聞こえるようになり、目が見えるようになりました。まだ動けないし、もちろん、まだまだ課題がありますが、動いている、ということが大事なのであります。

https://www.youtube.com/shorts/wN8ErF_LNPc

↑しゃべってます、一応。

ちょうど今日、慶応大学教授の安宅和人先生の「AIと歩む『残すに値する未来』」という講演を聞きにいきました。そこで安宅先生がドーンと強調されていたのが「physical AI」、ロボットであります(しかも、スライドのイラストはタチコマ!)。安宅先生もおっしゃっていました。いまは史上まれに見る変化の時代。そんな時代は楽しんだ者が勝ちですと。僕もそう思う!

すでに登録済みの方は こちら